マルチノードでの分散学習パッケージChainerMN 正式版 v1.0.0 をリリース

2017.09.01

データ並列のコア機能の安定化と、さらなる高速化を実現

株式会社Preferred Networks(本社:東京都千代田区、代表取締役社長 最高経営責任者:西川徹、以下、PFN)は、オープンソースの深層学習フレームワークChainer(チェイナー) に、マルチノードでの分散学習機能を追加するパッケージ ChainerMN ※1(チェイナー・エムエヌ)正式版 v 1.0.0 をリリースしました。

機械学習・深層学習技術の実用化に向け、より大きなデータを活用し、より精度の高い学習モデルを実現するために、学習に使われるモデルのパラメータ数や計算量が増大しています。

ChainerMNは、1ノード内の複数GPUまたは複数ノード間の両方での高速な通信により大規模分散深層学習を実現する、Chainer の追加パッケージです。PFNは2017年5月9日にChainerMN のβ版をリリースしており、今回は初の正式版のリリースとなります。ChainerMN v1.0.0 は、以下の機能が追加されています。

● ChainerMN v1.0.0 の特長

1. データ並列のコア機能の安定

安定性が向上したことにより、安心してご利用いただけます。

2. マルチGPUの集合通信ライブラリNVIDIA NCCL 2.0 をサポート

最新バージョンに対応したことで、より高速化しました。

3. サンプルコードの拡充(機械翻訳、DCGAN)

より先進的なChainerMN の使い方をサンプルを見て学ぶことが可能になりました。

4. 対応環境の拡充(非CUDA-AwareなMPIへの対応)

これまではOpen MPI, MVAPICH など、CUDA-Aware MPIの対応が必要でしたが、それ以外の環境でもChainerMN をご利用いただけます。

5. モデル並列機能の実験的サポート

複数GPUをこれまでと異なるモデル並列で連携させることで、より複雑な分散学習ができるようになりました。従来の手法(データ並列)では、精度を保ったまま使用ノード数を上げていこうとすると、実質的なバッチサイズに限界があることが知られています。これを克服して、さらなる速度向上を図るため、より挑戦的な手法であるモデル並列の一部を実験的に実装しています。

これらの機能により、ChainerMN での学習の安定化と、さらなる高速化の実現、ユーザビリティの改善を行っています。

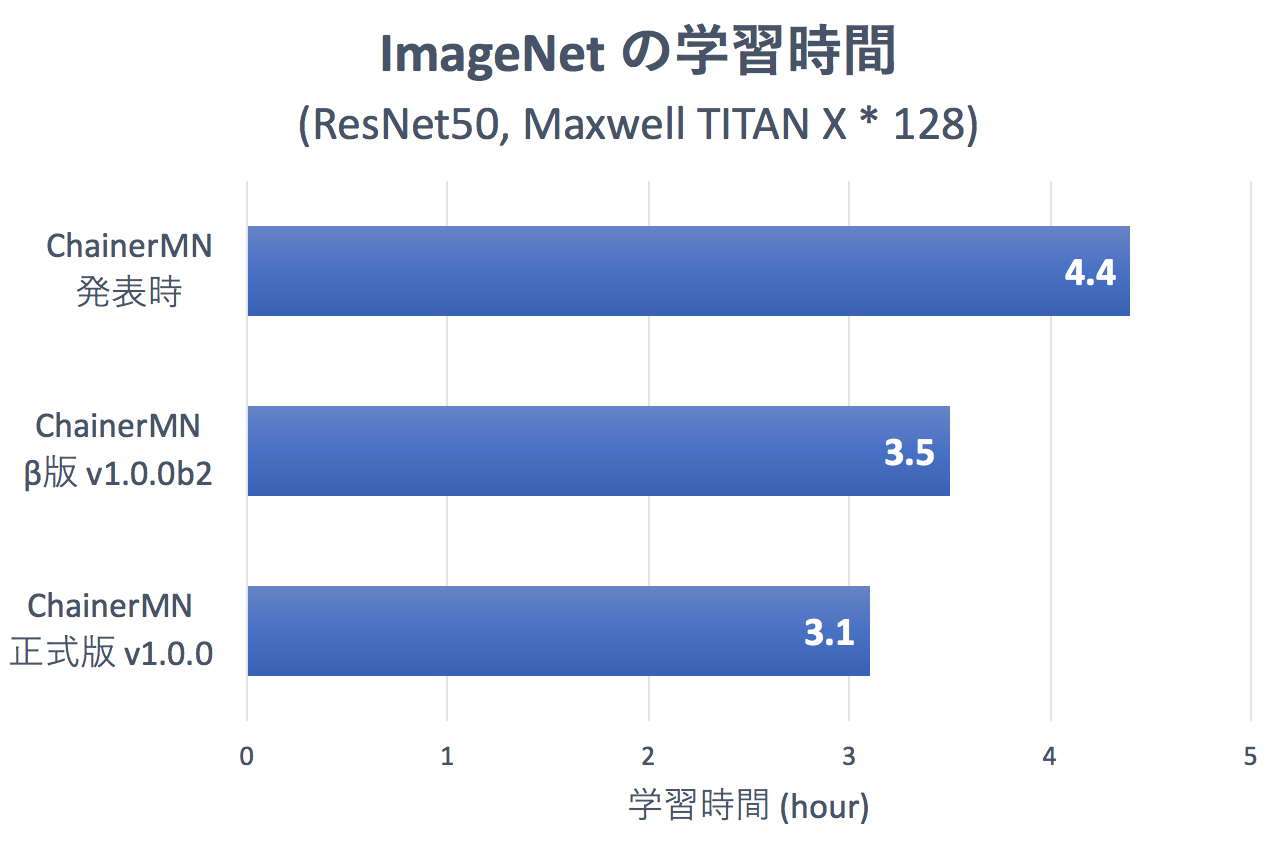

以下は、ImageNetの画像分類データセットを使ったChainerMN の性能測定の結果です。今年1月の発表時からは約1.4倍、5月に公開したβ版からは1.1倍高速という結果になりました。実験設定の詳細についてはこちらをご覧ください。

https://chainer.org/general/2017/02/08/Performance-of-Distributed-Deep-Learning-Using-ChainerMN.html

また、ChainerMN は2017年10月より、エクストリームデザイン株式会社(本社:東京都品川区、代表取締役:柴田 直樹)が提供するクラウドスパコン構築運用無人化サービス「XTREME DNA」で利用できるようになります。従量課金のパブリッククラウド Microsoft Azure のGPUインスタンスの分散並列環境テンプレートにChinerMN が追加されるため、大規模分散深層学習に必要なインフラ周りの環境構築が不要になるだけでなく、研究開発コストの管理も容易になります。

ChainerMN は、深層学習研究者・開発者がニューラルネットワークの設計にはじまる研究開発の主要部分に注力しやすい環境の提供を目指し、今後も継続的に機能追加、対応環境の拡充を進めてまいります。

■ オープンソースの深層学習フレームワークChainerについて (http://chainer.org/)

PFNが開発・提供するChainerは、Pythonベースのディープラーニング向けフレームワークとして、“Define-by-Run”アプローチによりユーザーが簡単かつ直感的に複雑なニューラルネットワークを設計し、学習させるための高い柔軟性とパフォーマンスを兼ね備えています。2015年6月にオープンソース化されたChainerは、最も普及しているディープラーニング向けフレームワークの1つとして、学術機関だけでなく、ディープラーニングの最新研究成果をいち早く現実世界のアプリケーションに活用するためのフレームワークを求める産業界においても、多くのユーザーに支持されています。